Anatomía de una red neuronal

De Ramón y Cajal a Open AI

¿Cuándo fue la última vez que utilizaste ChatGPT? ¿Ayer? ¿Esta mañana? ¿Lo estás utilizando ahora mismo para que te resuma este artículo?

La inteligencia artificial (IA) ha pasado en muy poco tiempo de ser una hipótesis futurista, uno de esos temas que aparecían en los libros de aprendizaje de inglés o en manuales de filosofía para provocar debates abstractos (casi siempre sobre dilemas morales lejanos), a convertirse en una realidad cotidiana que influye en múltiples ámbitos de nuestra vida.

Esto no pretende desacreditar ese tipo de reflexiones. En nuestra etapa formativa (y, en realidad, en cualquier etapa de la vida) pensar y debatir sobre el sentido de la vida, sobre qué nos hace humanos o sobre los límites de la tecnología es fundamental para desarrollar una conciencia moral. El problema surge cuando de esas conversaciones sacamos conclusiones rígidas sobre escenarios hipotéticos que no guardan relación con el estado real del conocimiento, con el ritmo del progreso científico o nuestro porvenir.

Muchos de los discursos que rodean la IA recalcan una falta de fé en la adaptación del hombre a su progreso, pensando que ciencia y humanidad no pueden ir de la mano. Esto antes se veía en las películas de ciencia ficción donde siempre hay una catástrofe interestelar y un régimen dictatorial en el universo, pero ahora también se aprecia en las conversaciones cotidianas sobre cómo la IA nos quitará el trabajo o nos volverá a todos iguales (tratado en la newsletter anterior). El objetivo de esta píldora es, precisamente, ofrecer una explicación “para dummies” de cómo funciona la inteligencia artificial y cuáles son sus orígenes, utilizando un enfoque sencillo y comparativo con el funcionamiento del cerebro humano. Comprender estos fundamentos, por supuesto, no resolverá todos los debates éticos ni permitirá emitir juicios definitivos, pero sí puede ayudar a rebajar algunos temores recurrentes, como por ejemplo la idea de que, en pocos años, viviremos en un mundo gobernado por máquinas que sustituirán completamente a los humanos.

Para ello contamos con la colaboración de Juan Luis Jurado, físico por la Universidad Complutense de Madrid, especializado en ciencia de datos e inteligencia artificial, campos en los que actualmente desarrolla su trabajo.

REDES NEURONALES, ¿NEUROCIENCIA O INFORMÁTICA?

Como estoy seguro que ya habéis notado, hay una relación muy estrecha entre la IA y la neurociencia. Una red neuronal es un sistema matemático que sirve para aprender patrones a partir de datos (lo que se conoce como entrenamiento) que luego usa para resolver tareas. Básicamente la IA aprende mediante ejemplos y repeticiones (blanco y en botella: leche.

Muchas de las arquitecturas utilizadas en inteligencia artificial se inspiran directamente en el funcionamiento de nuestro cerebro. En particular, el estudio de las sinapsis neuronales (los puntos de conexión entre neuronas donde se transmiten señales eléctricas y químicas) ha servido como modelo conceptual para diseñar los nodos y conexiones de las redes neuronales artificiales. Sin embargo, esto es sólo a un nivel superficial. Cuando miramos con lupa el comportamiento de las redes neuronales profundas, este difiere de manera radical con el comportamiento de las células de nuestro cerebro.

Neurona VS Perceptrón: Similitudes

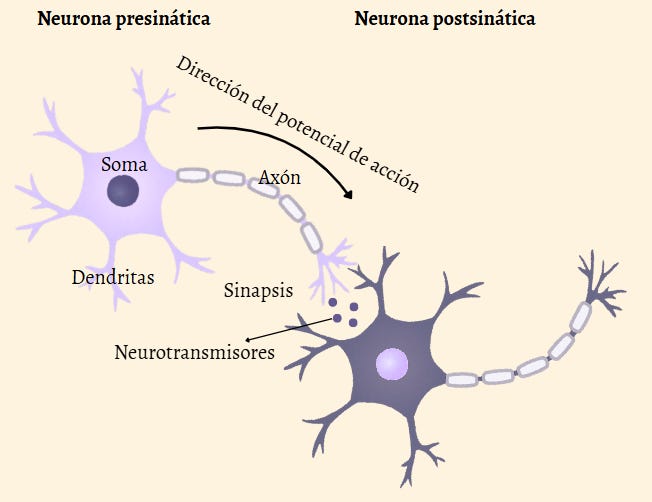

El cerebro humano está formado por neuronas, un tipo especializado de célula nerviosa compuesto, de manera simplificada, por tres partes principales: el cuerpo celular (soma), las dendritas (que actúan como antenas recibiendo señales) y el axón, que transmite esta información hacia otras neuronas por un proceso llamado sinapsis.

La sinapsis entre neuronas se produce mediante señales químicas. Si la señal es lo suficientemente fuerte, esa neurona se activará y transmitirá el impulso a otras, como una especie de dominó. En términos muy simplificados, pensar, percibir o recordar consiste en patrones de actividad eléctrica que recorren circuitos neuronales específicos. Cada experiencia, estímulo o pensamiento activa determinadas redes distribuidas por el cerebro.

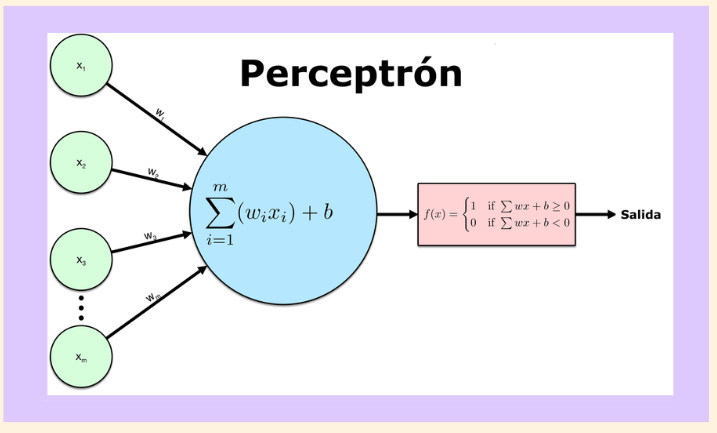

Veamos cómo encaja todo esto con un ejemplo de red neuronal básica: el perceptrón. Propuesto en 1957, es el abuelo de todas las redes neuronales modernas; el primer intento serio de enseñarle a una máquina a “pensar”. Si las redes neuronales son el cerebro de la IA, el perceptrón es su neurona: la pieza fundamental que constituye el sistema.

Y no es casualidad que lo llamemos así. El funcionamiento del perceptrón es extremadamente similar al de una neurona biológica, solo que en versión matemática. Como ella, tiene tres partes bien diferenciadas que trabajan en cadena:

Las dendritas → aquí llamadas pesos, reciben las señales de entrada y deciden cuánta importancia darle a cada una.

El soma → la función de interacción, que combina todas esas señales en un único valor.

El axón → la función de activación, que decide si ese valor es suficiente para “disparar” una respuesta o no.

Al recibir un estímulo externo x (i.e. una serie de entradas o inputs), cada valor se multiplica por su peso correspondiente y los resultados se suman (x1w1 + x2w2 + … + xmwm). Finalmente, esta suma pasa por la función de activación, que suele tener un comportamiento bastante simple: devuelve 1 si el valor supera un umbral predefinido (b), y 0 si no lo hace. Este mecanismo imita directamente la sinapsis neuronal, donde la neurona siguiente sólo puede estar activa o inactiva (sin término medio) si se supera cierto umbral.

A partir de aquí, la escalabilidad es natural: basta con conectar varios de estos perceptrones en cadena, de modo que la salida de uno se convierta en la entrada del siguiente. Con suficientes iteraciones (y suficientes datos de entrenamiento) el sistema ajusta progresivamente sus pesos hasta maximizar su capacidad predictiva. Si los datos son lo bastante ricos y representativos, el modelo no solo aprende a reconocer los ejemplos vistos, sino que aprende a generalizar. Y eso, en esencia, es una red neuronal simple.

Cerebro VS Redes Neuronales: Diferencias

Conexiones no lineales

Dicho esto, el perceptrón original está basado en la idea de neurona que teníamos a mitades del siglo XX, y que hoy en día se ha demostrado que es una completa hipersimplificación. La teoría de cable, vigente en esa época, sostenía que las dendritas eran cables pasivos cuya función es únicamente combinar de manera simple los estímulos de otras neuronas para realizar la sinapsis. Sin embargo, actualmente sabemos que las dendritas son extremadamente activas, siendo capaces de integrar los potenciales de maneras complejas y no lineales (no todos los estímulos activan de igual manera la neurona ni todos los potenciales de acción viajan en la misma dirección). El artículo de Albert Gidon et al., (2020), introduce un nuevo canal en la membrana de de las neuronas que permite que el potencial de acción viaje de manera inversa para moldear la integración de potencial de las dendritas. Es decir, en futuras ocasiones la neurona no se activará de la misma manera con el mismo estímulo, sino que hay aprendizaje. Por ello, no sólo es la manera de integrar la información mucho más compleja de lo que se pensaba, ¡sino que esta misma puede cambiar mediante aprendizaje!

Si entendemos la neurona como esta nueva célula, increíblemente compleja e interconectada, un modelo matemático que tenga una capacidad predictiva similar sería infinitamente más complejo. Esto rompe la metáfora neurona = perceptrón. De hecho, el artículo de Beniaguev et al., (2021), demuestra que para obtener resultados similares al de una neurona cortical aislada ¡se necesita un red neuronal profunda de unas 8 capas!

Cantidad de neuronas

Además, el cerebro humano posee muchísimas más conexiones neuronales que los modelos de IA más punteros. Se estima que el modelo GPT-5.2 tiene alrededor de 2 billones de parámetros, mientras que el cerebro humano cuenta con unas 100 mil millones de neuronas, unas 100 veces menos. Sin embargo, la recientemente descubierta complejidad de las neuronas indicaría que necesitan miles, sino millones de veces esta cantidad de parámetros para acercarse a la capacidad de nuestro cerebro, por lo que aún queda mucho camino por recorrer.

Superestructuras

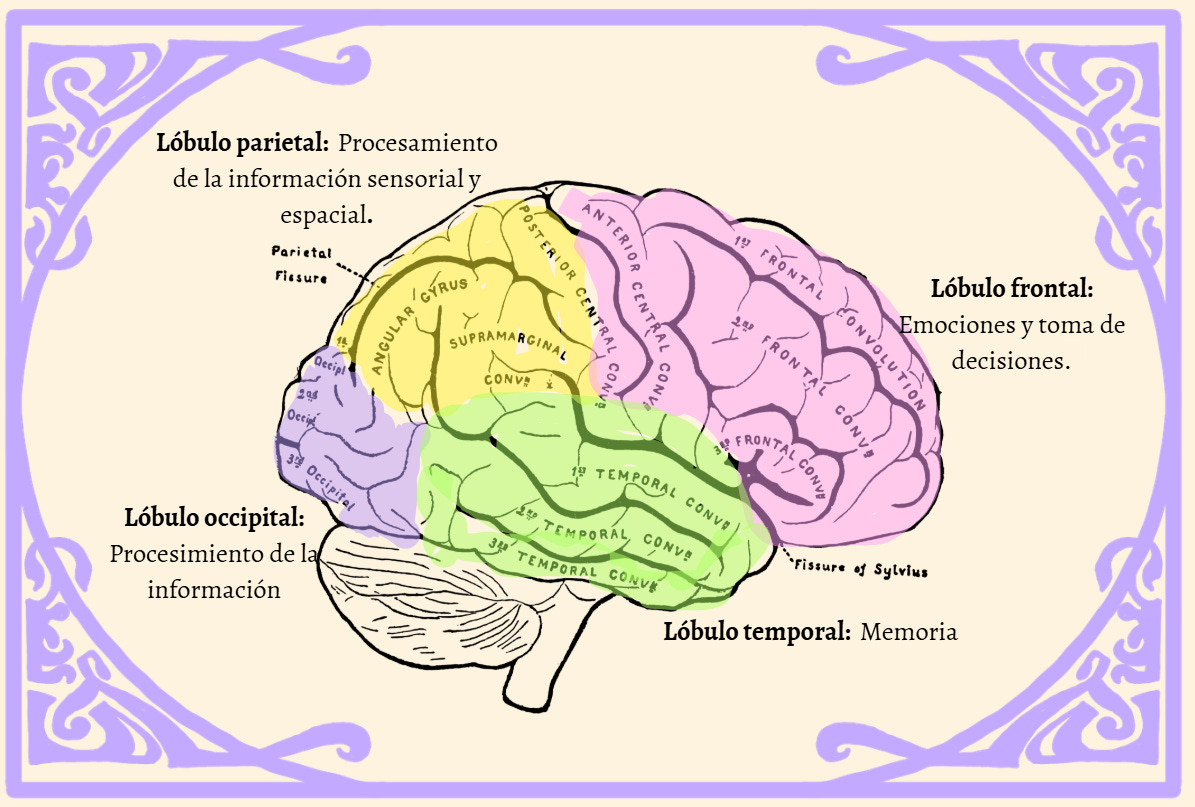

El cerebro también presenta una organización funcional por áreas, aunque estas no trabajan de manera aislada.

Pese a la posible comparativa entre la jerarquía que existe en el cerebro y las redes neuronales artificiales en la toma de decisiones, al haber áreas del cerebro que priman sobre otras, este posee redes altamente interconectadas y paralelas. Diferentes áreas pueden activarse simultáneamente, intercambiar información y formar circuitos dinámicos que no siguen una estructura estrictamente jerárquica.

Neuroplasticidad

También hay un aspecto fundamental que separa claramente el cerebro humano de los sistemas actuales de inteligencia artificial: la neuroplasticidad. La neuroplasticidad es la capacidad del cerebro para modificar su estructura y funcionamiento en respuesta a la experiencia. Esto implica que las conexiones entre neuronas pueden fortalecerse, debilitarse o incluso formarse de nuevo. Durante el aprendizaje o tras una lesión cerebral, por ejemplo, algunas neuronas liberan factores de crecimiento que favorecen la formación de nuevas conexiones sinápticas, ampliando o reorganizando la red neuronal.

En los sistemas de IA actuales esto no ocurre de la misma manera. Una red neuronal artificial no crea nuevas neuronas ni nuevas estructuras por sí sola. Su aprendizaje consiste en ajustar los pesos matemáticos de las conexiones existentes durante el entrenamiento, y la estructura de esta red no cambia durante este proceso. La arquitectura del modelo (el número de capas, nodos o conexiones) así como su estructura suele estar definida previamente por los ingenieros. En otras palabras, la IA aprende optimizando parámetros dentro de una estructura fija, mientras que el cerebro puede modificar la propia estructura de su red.

Velocidad y energía

Una dimensión en la que las redes neuronales profundas sí superan por mucho al cerebro es en la velocidad. La transmisión de los pulsos eléctricos dentro de una neurona viaja a una velocidad de unos pocos metros por segundo (entre 1 y 100 m/s), mientras que la electricidad en un cable puede viajar a velocidades cercanas a la de la luz: 200 millones de metros por segundo. La razón principal de esta disparidad es que en el caso de las neuronas, la información viaja mediante el movimiento de iones (partículas grandes cargadas) a través de procesos químicos, mientras que la electricidad son electrones (partículas indivisiblemente pequeñas) viajando por un material altamente conductor.

Aunque por supuesto, esta increíble velocidad tiene un origen bastante menos increíble: el gasto de energía que tienen los modelos de IA frente al de nuestro cerebro. Nuestro cerebro consume energía a un ritmo de unos 20 Vatios. Esto es equivalente a una bombilla de bajo consumo ecológica de estas que no sirven ni para leer. Por otro lado, supongo que no hace falta que os diga lo tremendamente ineficiente en términos de energía que son los modelos de IA actuales. Por ponerlo en perspectiva, OpenAI (la empresa que desarrolla ChatGPT y que cuenta con menos de 5000 empleados) consume más energía que todo Portugal, y proyecta superar a Alemania en 5 años y a India en 8. Para defenderse de posibles críticas, su CEO Sam Altman argumenta que bueno, la IA gasta mucha energía sí, pero más energía gastan los humanos en cosas como comer y respirar (sí, realmente lo dijo).

Finalmente, existe una diferencia conceptual importante que quiero dejar clara. Si sólo sacas una cosa en clara de toda esta sección, por favor, que sea esto.

La IA no “piensa” en el sentido humano del término.

Los modelos actuales funcionan mediante comparación estadística de patrones aprendidos durante su entrenamiento. No poseen conciencia ni comprensión propia; generan respuestas a partir de correlaciones en los datos. En el caso de los modelos de lenguaje como ChatGPT, Claude o Gemini, su función es intentar predecir la palabra más probable dado un texto anterior y según sus datos de entrenamiento. Nada más, y nada menos.

PERO, ¿CÓMO DE ACCURATE SON NUESTROS TEMORES FRENTE A LA IA?

Depende del caso, claro. La IA nos puede sorprender tanto para bien como para mal. Un ejemplo curioso: pídele a una versión antigua de ChatGPT que genere una imagen de una copa de vino llena hasta el borde. El resultado, casi con toda seguridad, te dejará con una copa a medias. ¿Por qué ocurre esto? Sencillo; en sus datos de entrenamiento apenas aparecen copas rebosantes. Y es que nadie sirve el vino hasta el borde, así que esas imágenes son raras. El modelo aprendió lo que vio, y lo que vio fueron copas a medio llenar.

Aquí viene la pregunta interesante: ¿y los vasos? ¿Los tarros? Esos sí aparecen llenos hasta arriba en miles de fotos. ¿No debería el modelo ser capaz de trasladar ese concepto a una copa de vino? La respuesta es sí, y de hecho los modelos más recientes de OpenAI ya lo hacen sin problema. La brecha entre generaciones es real, y este pequeño detalle lo deja al descubierto.

Pero este ejemplo revela algo mucho más inquietante: la velocidad a la que evoluciona la IA. Comparar los modelos de hace apenas dos años con los de hoy es como comparar un mapa de papel con el GPS. El salto no es lineal, es exponencial, y cada nueva generación deja a la anterior mirando desde el banquillo.

Y eso genera preguntas que cuesta ignorar. ¿Dónde está el techo? ¿Llegará un punto en que la IA supere al humano en cualquier tarea imaginable? ¿Cuándo perderemos la capacidad de distinguir qué hay detrás de una obra, una decisión o una conversación? Nadie tiene las respuestas. Pero el ritmo al que se plantean las preguntas se acelera cada día.

A medida que la IA mejora más y más, tareas que antes desarrollaban humanos se van apoyando incrementalmente en esta. Hemos llegado al punto en el que gran parte del software nuevo que se desarrolla lo hace una IA. Esto es un ejemplo de la IA desarrollando tecnología “por su cuenta”, un temor que comparte también bastante gente.

Como dijo muy elocuentemente nuestro querido expresidente M. Rajoy: “...tenemos que fabricar máquinas que nos permitan seguir fabricando máquinas, porque lo que no va a hacer nunca la máquina es fabricar máquinas…”. Bien, no sé del todo lo que aclara esta cita, pero ahí la lleváis.

Bromas aparte, la IA es una herramienta increíblemente potente, con todo lo que ello conlleva, y tiene la capacidad de transformar el mundo para siempre, si es que no lo ha hecho ya. Dicho esto, sigue siendo una herramienta desarrollada por los humanos para ayudar en ciertas tareas, ni más ni menos. Comprendiendo un poco su funcionamiento, vemos que la inteligencia en la IA aparece sólo en el nombre y que está muy alejada del funcionamiento del cerebro humano, que definimos como verdaderamente inteligente.

HACIA EL FUTURO

La investigación en campos como la neurociencia computacional, la psicología cognitiva o incluso la física cuántica (que explora nuevas formas de computación basadas en principios cuánticos) continúa influyendo en la manera en que se diseñan los sistemas de IA. El objetivo, al menos en su formulación más ambiciosa, sigue siendo el mismo que inspiró a los pioneros de Dartmouth (primera conferencia de IA celebrada en 1956, más información sobre esto en el link de debajo): crear herramientas capaces de aprender, razonar y resolver problemas de una forma que simula la inteligencia humana.

Entender esta evolución histórica ayuda a poner en perspectiva el momento actual: lo que hoy parece una revolución repentina es, en realidad, el resultado de más de setenta años de investigación, avances científicos y cambios tecnológicos acumulados.

AGRADECIMIENTOS:

En esta píldora quiero agradecer de todo corazón la ayuda de Juan Luis Jurado, nuestro experto en IA. Juanlu es muy cercano a nosotras, un gran amigo que ha estado implicado en el proyecto desde el primer momento: ayudándonos a poner en marcha el Substack, aportando feedback en cada decisión y acompañando el proceso. Probablemente, sin él, esta newsletter no existiría.